- 文章 概述本文介紹了人工智能(AI)、 機器學習( ML)、深度學習(DL)和邊緣人工智能(Edge AI )的 概念、特性及應用領域 ,詳細闡述了ML的各種 訓練模式 ,包括監督式、非監督式、半監督式、強化學習和自監督學習,并介紹了它們在各個領域的應用。最后,文章總結了AI、ML和Edge AI對各行各業的影響和未來 發展前景 ,強調它們將不斷推動創新,為全球經濟和社會帶來更加智能、便捷的生活方式。人工智

- 關鍵字:

Digikey 人工智能 機器學習 深度學習

- MCX N系列NPU, 作為先進的人工智能處理器,以其強大的計算能力和高效的算法優化,不僅能夠處理復雜的圖像識別任務,還能在咖啡研磨過程中實現精準控制,確保每一粒咖啡豆都能得到恰到好處的處理。為AI咖啡機注入了前所未有的智能動力!先說結論,利用150MHz MCX N的NPU去推理咖啡豆烘焙程度(39mS)比用400MHz的M7內核推理(109mS)快了3倍!作為一名“咖市”的“MCU系統與應用工程師”一直為研磨咖啡豆的顆粒度而感到苦惱,每次換豆都要浪費2次18克豆子去實現“18克豆,10bar,30秒內

- 關鍵字:

NPU AI咖啡機 深度學習

- TFLite模型的開盲盒體驗之flatbuffer格式介紹相信在嵌入式平臺上部署過神經網絡模型的伙伴,都不會對TFLite格式陌生。TFLite是谷歌推出的一個輕量級推理庫,它的主要目標是在移動端和嵌入式設備上部署深度學習模型。為了在這些設備上運行,需要將訓練好的TensorFlow模型轉換成一種特殊的格式,這就是TensorFlow Lite模型。轉換過程包括模型轉化、部署和優化三個步驟,旨在提升運算速度并減少內存、顯存占用。具體來說,這其中最終要的就是以.TFLite為格式的模型文件,其主結構為一個M

- 關鍵字:

TFLite 模型 推理庫 深度學習

- 近年來,機器視覺系統越來越多地基于可變條件進行自動化決策。開發這些系統所需的時間和精力可能會讓人望而卻步。而深度學習的出現正在改變這一局面,并使自動化決策觸手可及。開源庫、Nvidia硬件和FLIR相機等資源正在幫助實現這一變化。走進深度學習“一張圖片勝過千言萬語”這句話在機器視覺領域里從未像今天這樣真實。機器視覺可以將數千甚至數百萬行代碼用簡單地經過圖片和少量編碼訓練后的的神經網絡所代替。深度學習是一種機器學習形式,它使用在輸入和輸出節點之間有許多“深層”層的神經網絡。通過在大數據集上訓練網絡,可以創建

- 關鍵字:

Firefly DL 深度學習 人工智能

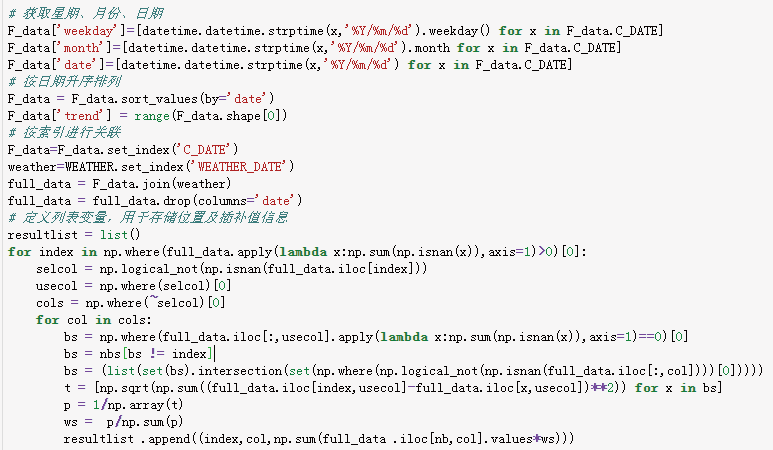

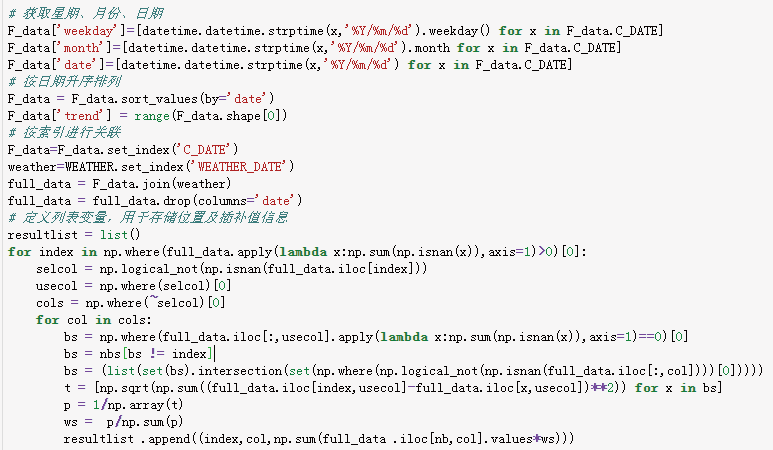

- 短期電力負荷精準預測對發電容量與輸電方式的合理調度、確保電力系統安全、穩定運行起著至關重要的作用。本文針對負荷數據基數大、難提取、負荷預測影響因素多等問題,運用Mysql數據庫和Python爬蟲技術構建了短期負荷曲線預測基礎數據平臺,提高了數據的存取效率;針對電力負荷的隨機波動性,運用Pandas、關聯分析算法完成了缺失值處理和影響因素與用電負荷的相關性分析;為提高預測精度,探索使用了融合卷積神經網絡、長短期記憶網格和注意力機制的多元混合神經網絡模型。

- 關鍵字:

202302 深度學習 短期負荷預測 卷積神經網絡 長短期記憶網格 Flask

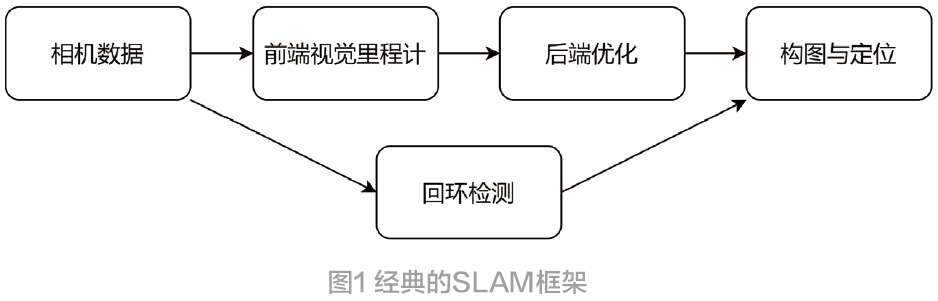

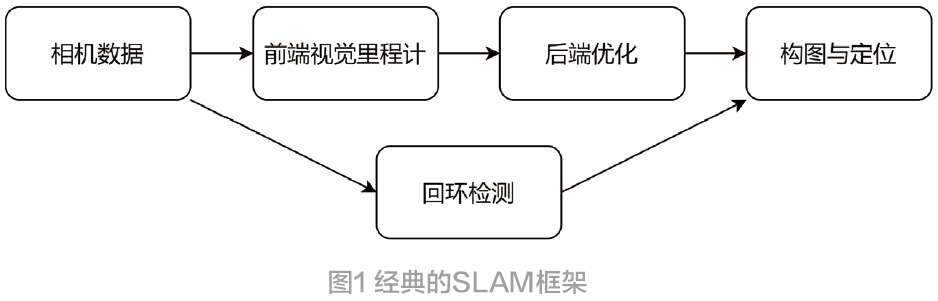

- 視覺慣性導航一直是無人駕駛與機器人領域重點、難點環節。首先介紹經典算法框架,從基于最優平滑算法和預積分理論兩個層面介紹經典視覺慣性融合算法。然后介紹新型算法框架,主要在深度學習基礎上,從對整體框架學習的程度,將新型視覺慣性融合算法分為兩類,部分學習和整體學習,最后介紹了主流算法中關鍵技術與未來展望。

- 關鍵字:

202302 視覺慣性導航 優化 耦合算法 深度學習

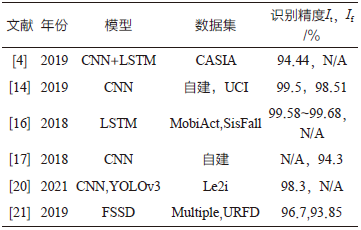

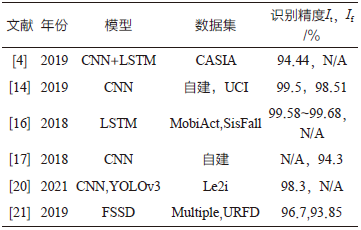

- 基于意外跌倒是造成老年人受傷、失能及死亡的主要原因,對近年來關于深度學習的跌倒檢測研究進行了介紹。根據跌倒檢測工作流程,從數據采集、數據處理、模型訓練及狀態識別幾個方面進行了詳細介紹,并對已有的基于深度學習的跌倒檢測方法進行分析與比較,為將來的應用研究提供參考,并對將來的發展方向提出一些思考。

- 關鍵字:

深度學習 跌倒檢測 卷積神經網絡 長短期記憶網絡 202212

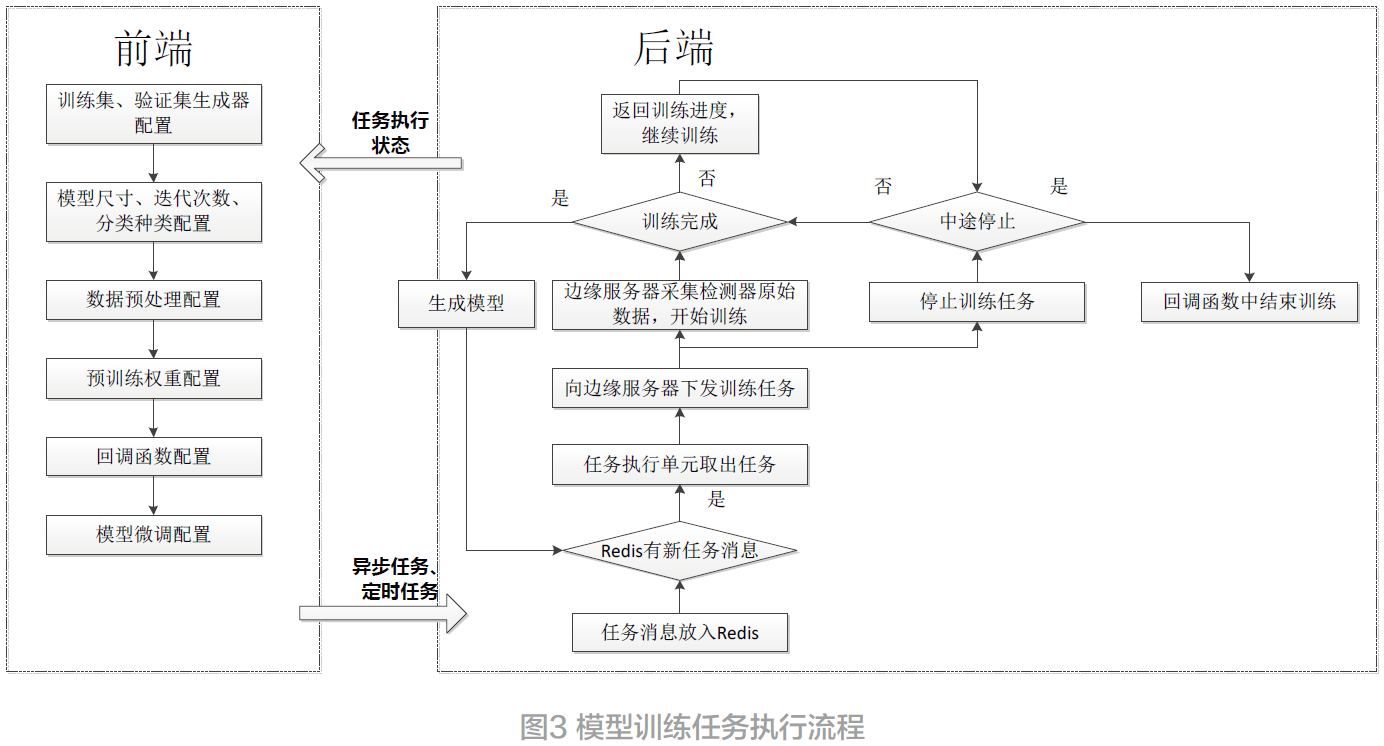

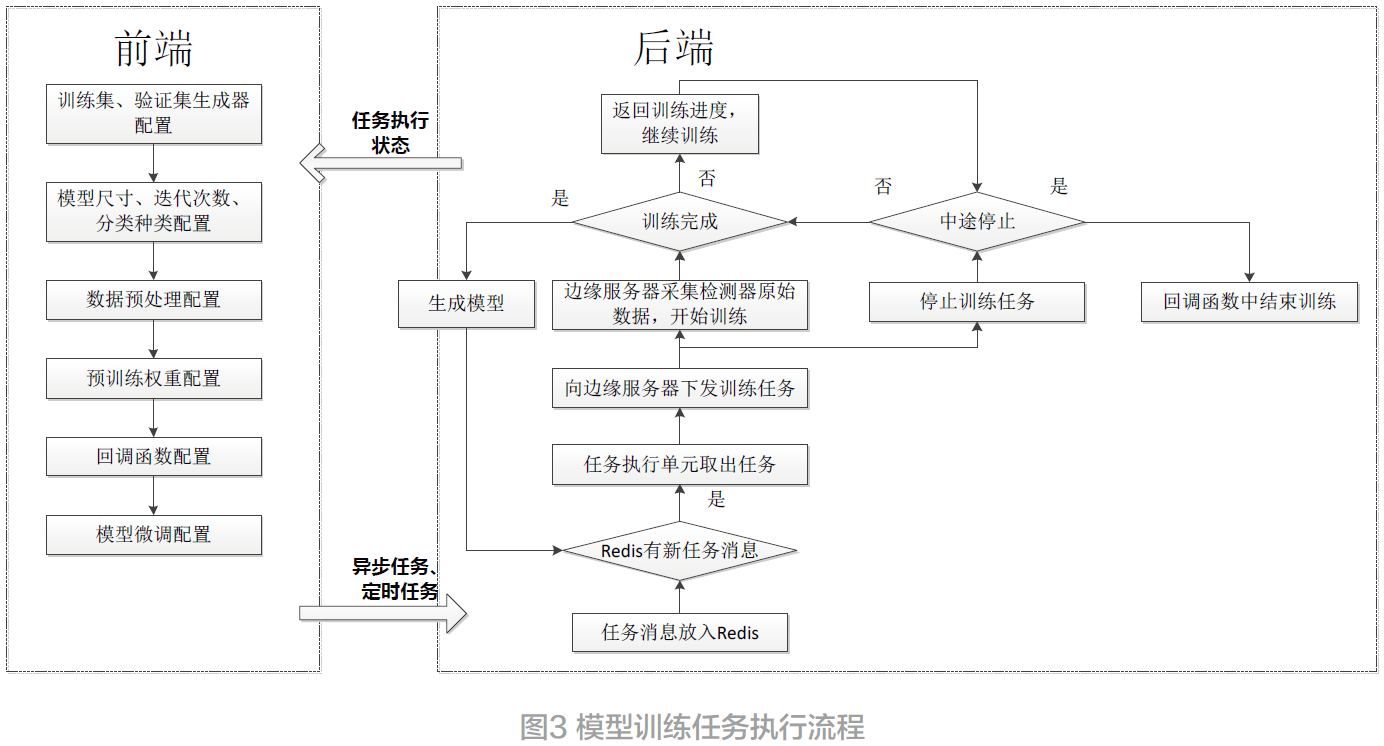

- 將云邊協同技術應用到深度學習模型的訓練和部署,可以解決目前工業質檢領域深度學習模型訓練和部署方法的不足,使模型的訓練和部署更加安全、高效、智能化、低成本。

- 關鍵字:

云邊協同 深度學習 服務器部署 202212

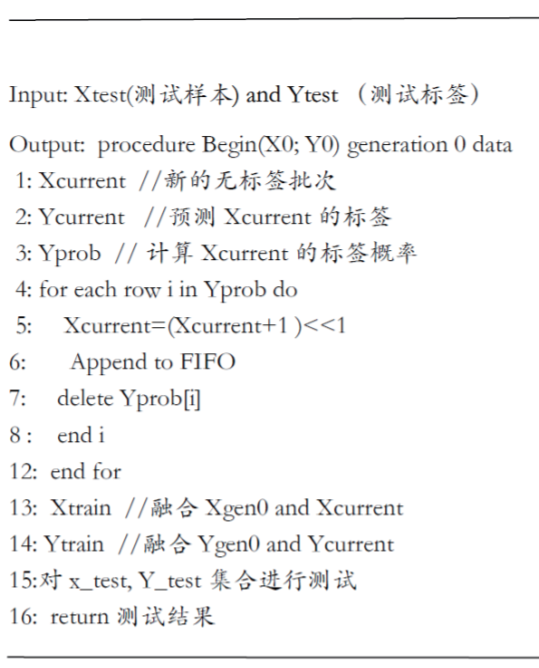

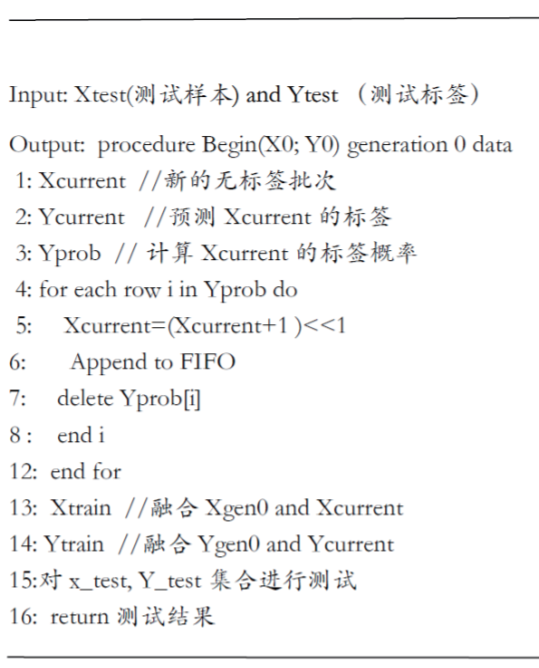

- 摘 要:本文設計了一種改進的可遷移深度學習模型。該模型能夠在離開可靠的訓練環境(其中存在標簽)并被

置于純粹的無標簽數據的領域時,輸出依然可以持續得到改善,這種訓練方式可以降低對監督學習的依賴程度。關鍵詞:可遷移;深度學習;無標簽*基金項目:湖南省教育廳科學研究課題“基于深度學習的智能無人機目標檢測算法研究”(20C0105);湖南省

自然科學基金項目《基于高光譜特征信息融合的油菜籽品質參數反演與建模》(2021JJ60093);校級培育項目

“基于深度學習的目標檢測算法研究”(22mypy15)1

- 關鍵字:

202210 可遷移 深度學習 無標簽

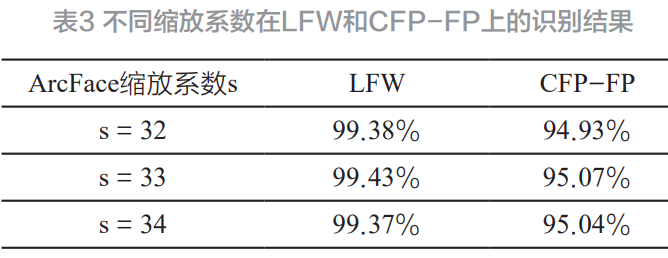

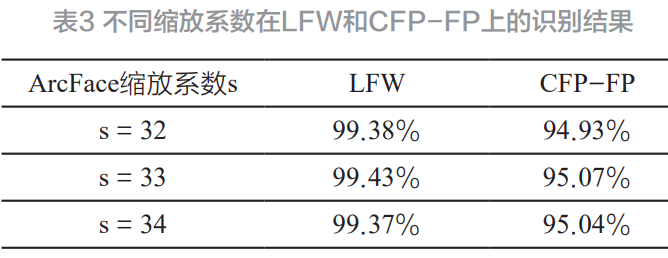

- 摘要:雖然現已有許多關于圖像注意力機制的研究,但是現有的方法往往忽視了特征圖的全局空間結構和空

間注意力與通道注意力的聯系。所以本文提出了一種基于整個空間拓撲結構的注意機制,將特征圖映射成結點

與特征的形式,再借助圖卷積網絡的特性,得以從整個空間學習特征權重圖。其次空間注意力與通道注意力一

體化結構能夠更有效地學習特征權重。通過多個實驗測試表明,在圖像分類和人臉識別任務中,展現了優異的

性能和普遍適用性。關鍵詞:深度學習;注意力機制;圖像分類;人臉識別

隨著計算機性能的提升,卷積神經網絡 (co

- 關鍵字:

202207 深度學習 注意力機制 圖像分類 人臉識別

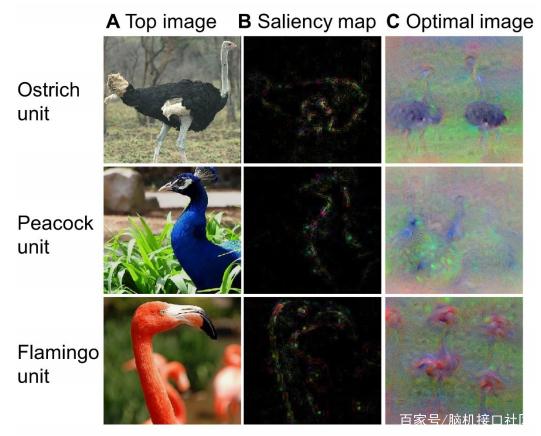

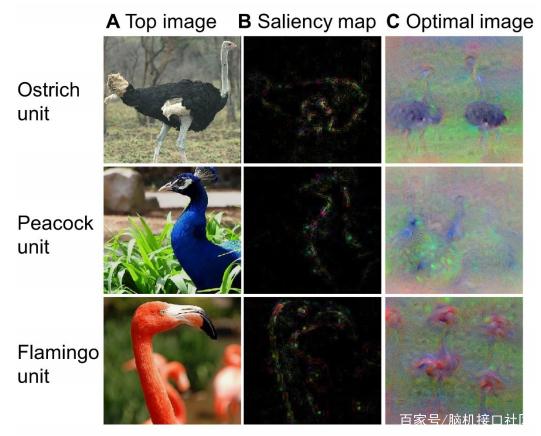

- 編譯|蔣寶尚 關于AI是什么,學界和業界已經給出了非常多的定義,但是對于AI理解,探討尚不足。換句話說,計算機科學家解釋深度神經網絡(DNNs)的能力大大落后于我們利用其取得有用結果的能力。 當前理解深度神經網絡的常見做法是在單個神經元特性上“折騰”。例如,激活識別貓圖像的神經元,而關閉其他神經元的“控制變量法”。這種方法的學術術語叫做“類選擇性”。 由于直觀和易理解,“類選擇性”在學界廣泛應用。誠然,在訓練過程中,這類可解釋的神經元確實會“選擇性地”出現在各種不同任務網絡中。例如,預測產品評論

- 關鍵字:

DNN 深度神經網絡 深度學習

- 來源:nature 編譯:張大筆茹、小七 假設一輛自動駕駛汽車看到停車標志時并沒有減速,而是加速駛入了繁忙的十字路口,從而導致了交通事故。事故報告顯示,停車標志的表面粘了四個小的矩形標志。這說明一些微小擾動就能愚弄車載人工智能(AI),使其將“停止”一詞誤讀為“限速45”。 目前,此類事件還未發生,但是人為擾動可能影響AI是非常現實的。研究人員已經展示了如何通過粘貼紙來欺騙AI系統誤讀停車標志,或者通過在眼鏡或帽子上粘貼印刷圖案來欺騙人臉識別系統,又或者通過在音頻中插入白噪聲使語音識別系統產生錯

- 關鍵字:

DNN 深度神經網絡 深度學習

- 導讀深度神經網絡(DNN)通過端到端的深度學習策略在許多具有挑戰性的任務上達到了人類水平的性能。深度學習產生了具有多層抽象層次的數據表示;然而,它沒有明確地提供任何關于DNNs內部運作的解釋,換句話說它的內部運作是一個黑盒子。深度神經網絡的成功吸引了神經科學家,他們不僅將DNN應用到生物神經系統模型中,而且還采用了認知神經科學的概念和方法來理解DNN的內部表示。盡管可以使用諸如PyTorch和TensorFlow之類的通用深度學習框架來進行此類跨學科研究,但是使用這些框架通常需要高級編程專家和全面的數學知

- 關鍵字:

DNN 深度神經網絡 深度學習 腦機接口

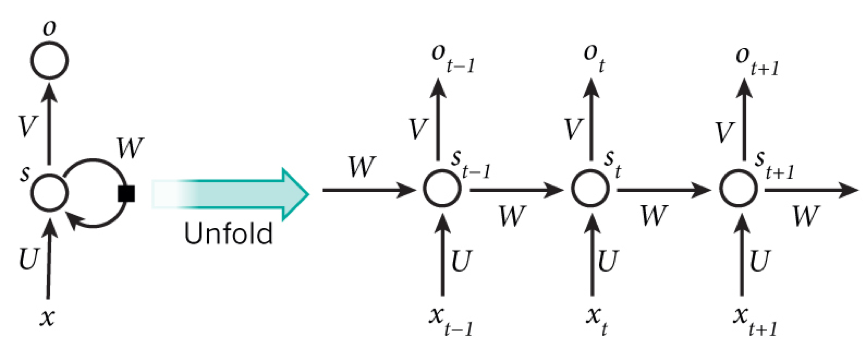

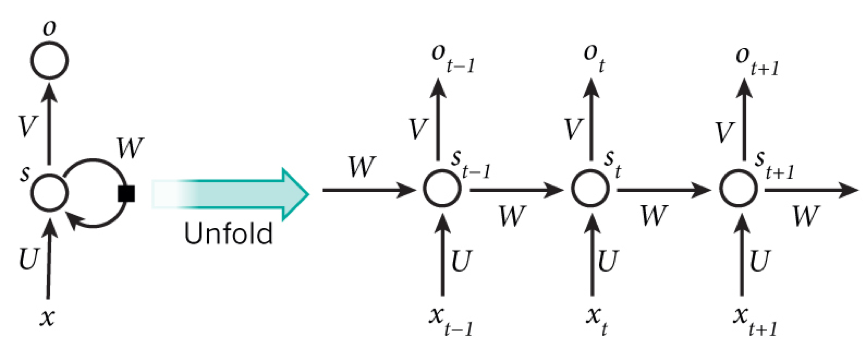

- 先說DNN,從結構上來說他和傳統意義上的NN(神經網絡)沒什么區別,但是神經網絡發展時遇到了一些瓶頸問題。一開始的神經元不能表示異或運算,科學家通過增加網絡層數,增加隱藏層可以表達。并發現神經網絡的層數直接決定了它對現實的表達能力。但是隨著層數的增加會出現局部函數越來越容易出現局部最優解的現象,用數據訓練深層網絡有時候還不如淺層網絡,并會出現梯度消失的問題。我們經常使用sigmoid函數作為神經元的輸入輸出函數,在BP反向傳播梯度時,信號量為1的傳到下一層就變成0.25了,到最后面幾層基本無法達到調節參數

- 關鍵字:

DNN 深度神經網絡 深度學習 CNN RNN

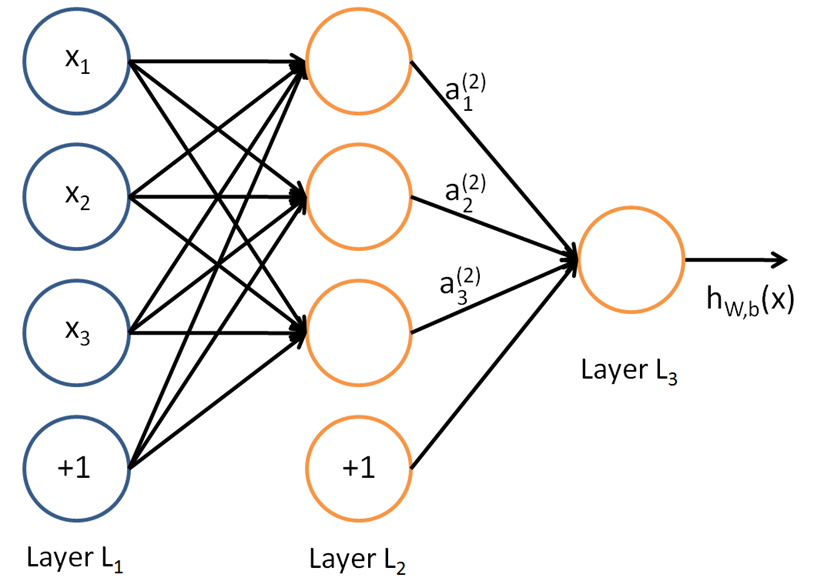

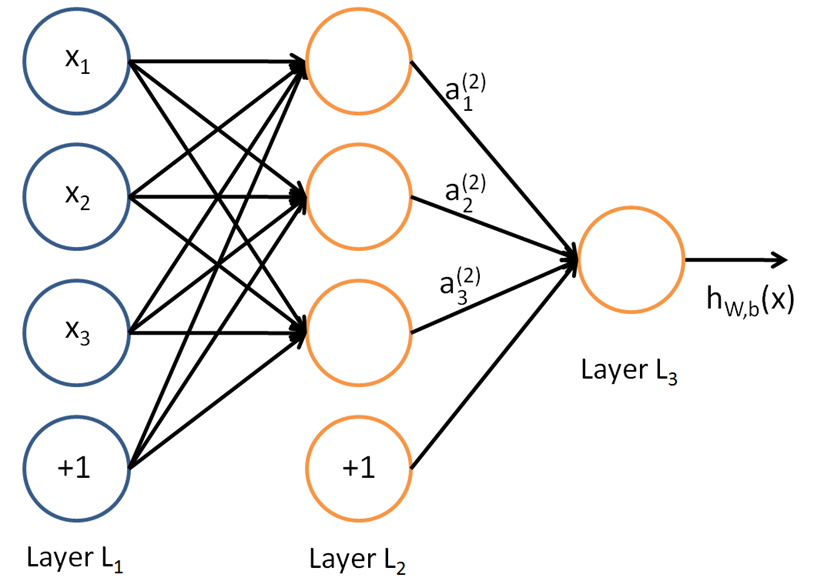

- 深度神經網絡(Deep Neural Networks,以下簡稱DNN)是深度學習的基礎,而要理解DNN,首先我們要理解DNN模型,下面我們就對DNN的模型與前向傳播算法做一個總結。 1.從感知機到神經網絡 在感知機原理小結中,我們介紹過感知機的模型,它是一個有若干輸入和一個輸出的模型,如下圖: 輸出和輸入之間學習到一個線性關系,得到中間輸出結果: z=∑i=1mwixi+bz=∑i=1mwixi+b 接著是一個神經元激活函數: sign(z)={?11z<0z≥0sign(z)={

- 關鍵字:

DNN 深度神經網絡 深度學習

深度學習介紹

您好,目前還沒有人創建詞條深度學習!

歡迎您創建該詞條,闡述對深度學習的理解,并與今后在此搜索深度學習的朋友們分享。

創建詞條

關于我們 -

廣告服務 -

企業會員服務 -

網站地圖 -

聯系我們 -

征稿 -

友情鏈接 -

手機EEPW

Copyright ?2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

《電子產品世界》雜志社 版權所有 北京東曉國際技術信息咨詢有限公司

京ICP備12027778號-2 北京市公安局備案:1101082052 京公網安備11010802012473