強攻 GPU,TPU 芯片一夜躥紅

自 ChatGPT 爆火之后,AI 大模型的研發層出不窮,而在這場「百模大戰」激戰正酣之際,美國芯片公司英偉達卻憑借其 GPU 在大模型計算中的出色發揮賺得盆滿缽滿。

本文引用地址:http://www.j9360.com/article/202408/462193.htm然而,近日蘋果的一項舉動,給英偉達的火熱稍稍降溫。

AI 模型訓練,蘋果選擇 TPU 而非 GPU

英偉達一直是 AI 算力基礎設施領域的領導者,在 AI 硬件市場,尤其是 AI 訓練領域,其市場份額在 80% 以上,英偉達 GPU 一直是亞馬遜、微軟、Meta、OpenAI 等眾多科技巨頭在 AI 和機器學習領域的首選算力解決方案。

因此,英偉達也持續遭遇行業內多元挑戰,競爭對手中不乏自主研發 GPU 的強者,亦有探索創新架構的先驅。谷歌的 TPU 也憑借其獨特優勢,成為英偉達不容忽視的強大對手。

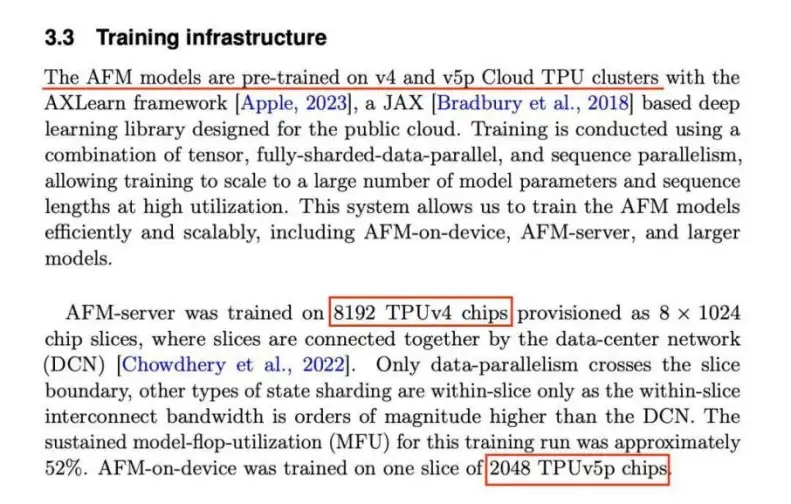

7 月 30 日,蘋果公司發布了一篇研究論文。在論文中,蘋果介紹了給 Apple Intelligence 提供支持的兩個模型——AFM-on-device(AFM 是蘋果基礎模型的縮寫)和 AFM-server(一個基于服務器的大語言模型),前者是一個 30 億參數的語言模型,后者則是一個基于服務器的語言模型。

蘋果在論文中表示,為了訓練其 AI 模型,使用了谷歌的兩種張量處理器(TPU),這些單元被組成大型芯片集群。為了構建可在 iPhone 和其他設備上運行的 AI 模型 AFM-on-device,蘋果使用了 2048 個 TPUv5p 芯片。對于其服務器 AI 模型 AFM-server,蘋果部署了 8192 個 TPUv4 處理器。

蘋果放棄英偉達 GPU 轉向谷歌 TPU 的戰略選擇,在科技界投下了一枚震撼彈,當日英偉達股價應聲下跌超 7%,創下三個月來最大跌幅,市值蒸發 1930 億美元。

業內人士表示,蘋果的決定表明一些大型科技公司在人工智能訓練方面可能正在尋找英偉達圖形處理單元的替代品。

TPU VS GPU,誰更適合大模型?

在討論 TPU 與 GPU 誰更適合大模型之前,我們需要對這兩者有一個初步的了解。

TPU 與 GPU 對比

TPU 全稱 Tensor Processing Unit,是谷歌專門為加速機器學習工作負載而設計的專用芯片,它主要應用于深度學習模型的訓練和推理。值得注意的是,TPU 也屬于 ASIC 芯片的一類,而 ASIC 是一種為了某種特定的需求而專門定制的芯片。

GPU 大家就比較熟悉了,GPU 是最初為圖形渲染設計的處理器,后來廣泛用于并行計算和深度學習。它具有強大的并行處理能力,經過優化后的 GPU,也非常適合深度學習和科學計算等并行任務。

可以看到,這兩種不同的芯片在初始設計時便有著各自不同的目標。

與傳統的 CPU 相比,GPU 的并行計算能力使其特別適合處理大規模數據集和復雜計算任務,于是在 AI 大模型爆發的近幾年,GPU 一度成為 AI 訓練的算力硬件首選。

然而,隨著 AI 大模型的不斷發展,計算任務在指數級地日益龐大與復雜化,這對計算能力與計算資源提出了全新的要求,GPU 用于 AI 計算時的算力利用率較低、能耗較高的能效比瓶頸,以及英偉達 GPU 產品的價格高昂和供貨緊張,讓本就是為深度學習和機器學習而生的 TPU 架構受到更多的關注。GPU 在這一領域的霸主地位開始面臨挑戰。

據悉,谷歌早在 2013 年就開始在內部研發專用于 AI 機器學習算法的芯片,直到 2016 年這款自研的名叫 TPU 的芯片才被正式公開。在 2016 年 3 月打敗李世石和 2017 年 5 月打敗柯杰的 AlphaGo,就是使用谷歌的 TPU 系列芯片訓練而成。

如果說 TPU 更適合用作 AI 大模型訓練,不具體說明它的「本領」恐怕難以令眾人信服。

TPU 如何適合大模型訓練?

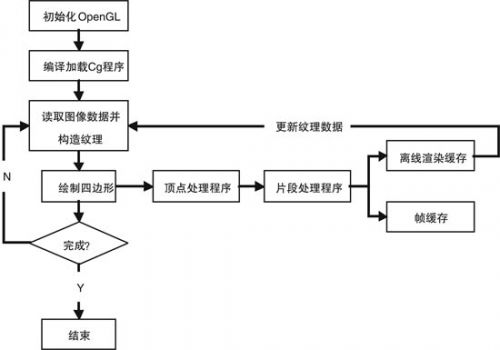

首先,TPU 具有多維度的計算單元提高計算效率。相較于 CPU 中的標量計算單元和 GPU 中的矢量計算單元,TPU 使用二維乃至更高維度的計算單元完成計算任務,將卷積運算循環展開的方式實現最大限度的數據復用,降低數據傳輸成本,提升加速效率。

其次,TPU 具有更省時的數據傳輸和高效率的控制單元。馮諾依曼架構帶來的存儲墻問題在深度學習任務當中尤為突出,而 TPU 采用更為激進的策略設計數據傳輸,且控制單元更小,給片上存儲器和運算單元留下了更大的空間。

最后,TPU 具有設計面向 AI 的加速,強化 AI/ML 計算能力。定位準確,架構簡單,單線程控制,定制指令集,TPU 架構在深度學習運算方面效率極高,且易于擴展,更適合超大規模的 AI 訓練計算。

據悉,谷歌 TPUv4 與英偉達 A100 相比的功耗低 1.3-1.9 倍,在 Bert、ResNet 等多類工作模型中,效率高于 A100 1.2- 1.9 倍;同時其 TPUv5/TPU Trillium 產品相比 TPUv4,能夠進一步提升 2 倍/接近 10 倍的計算性能。可以看到谷歌 TPU 產品相比英偉達的產品在成本與功耗上存在更多優勢。

在今年 5 月的 I / O 2024 開發者大會上,Alphabet 首席執行官桑達爾·皮查伊(Sundar Pichai)宣布了第六代數據中心 AI 芯片 Tensor 處理器單元(TPU)--Trillium,稱該產品的速度幾乎是上一代產品的五倍,并表示將于今年晚些時候推出交付。

谷歌表示,第六代 Trillium 芯片的計算性能比 TPU v5e 芯片提高 4.7 倍,能效比 v5e 高出 67%。這款芯片旨在為從大模型中生成文本和其他內容的技術提供動力。谷歌還表示,第六代 Trillium 芯片將在今年年底可供其云客戶使用。

谷歌的工程師通過增加高帶寬內存容量和整體帶寬實現了額外的性能提升。人工智能模型需要大量的高級內存,而這一直是進一步提高性能的瓶頸。

值得注意的是,谷歌并不會以獨立產品的形態單獨出售自己的 TPU 芯片,而是通過谷歌云平臺(Google Cloud Platform,簡稱 GCP)向外部客戶提供基于 TPU 的算力服務。

在這一方案上也可窺見谷歌的聰明之處:直接銷售硬件涉及高昂的開銷和復雜的供應鏈管理。而通過云服務提供 TPU,谷歌可以簡化安裝、部署和管理過程,減少不確定性和額外開銷。這樣的模式也簡化了銷售流程,無需額外建立硬件銷售團隊。另外,谷歌正在與 OpenAI 就生成性 AI 進行激烈的競爭,如果谷歌開始銷售 TPU,它將同時與兩個強大的對手競爭:英偉達和 OpenAI,這可能不是目前最明智的策略。

文章說到這里,可能會有人發問:既然 TPU 具有如此出色的性能優勢,是否會在很快的未來取代 GPU?

現在談取代 GPU?或許為時尚早

這一問題也并沒有這么簡單。

只說 TPU 的優勢,不講 GPU 的優勢,可謂是一葉障目。接下來我們還要了解一下相比 TPU,GPU 又是如何適用于當前的 AI 大模型訓練。

我們看到 TPU 的優勢在于出眾的能效比與單位成本算力指標,然而作為一種 ASIC 芯片,其試錯成本高的劣勢也較為明確。

此外,在生態系統的成熟度方面。GPU 經過多年的發展,擁有龐大且成熟的軟件和開發工具生態。眾多的開發者和研究機構長期基于 GPU 進行開發和優化,積累了豐富的庫、框架和算法。而 TPU 的生態相對較新,可用的資源和工具可能不如 GPU 豐富,這對于開發者來說可能增加了適配和優化的難度。

在通用性方面。GPU 最初是為圖形渲染設計,但其架構具有較高的靈活性,能夠適應多種不同類型的計算任務,不僅僅局限于深度學習。這使得 GPU 在面對多樣化的應用場景時具有更強的適應性。相比之下,TPU 是專為機器學習工作負載定制設計的,對于其他非機器學習相關的計算任務,可能無法像 GPU 那樣有效地處理。

最后,GPU 市場競爭激烈,各廠商不斷推動技術創新和產品更新,新的架構和性能提升較為頻繁。而 TPU 的發展主要由谷歌主導,其更新和演進的節奏可能相對較慢,

整體來說,英偉達和谷歌在 AI 芯片上的策略各有側重:英偉達通過提供強大的算力和廣泛的開發者支持,推動 AI 模型的性能極限;而谷歌則通過高效的分布式計算架構,提升大規模 AI 模型訓練的效率。這兩種不同的路徑選擇,使得它們在各自的應用領域中都展現出了獨特的優勢。

蘋果選擇谷歌 TPU 的原因可能在于以下幾點:首先,TPU 在處理大規模分布式訓練任務時表現出色,提供高效、低延遲的計算能力;其次,使用 Google Cloud 平臺,蘋果可以降低硬件成本,靈活調整計算資源,優化 AI 開發的總體成本。此外,谷歌的 AI 開發生態系統還提供了豐富的工具和支持,使得蘋果能夠更高效地開發和部署其 AI 模型。

蘋果的實例證明了 TPU 在大模型訓練上的能力。但相比于英偉達,TPU 目前在大模型領域的應用依舊還是太少,背后更多的大模型公司,包括 OpenAI、特斯拉、字節跳動等巨頭,主力 AI 數據中心依然是普遍采用英偉達 GPU。

因此,現在就下定義說谷歌的 TPU 可以打敗英偉達的 GPU 或許為時尚早,不過 TPU 一定是一個具有極強挑戰力的選手。

GPU 的挑戰者,不只 TPU

中國也有押注 TPU 芯片的企業—中昊芯英。中昊芯英創始人楊龔軼凡曾在谷歌作為芯片研發核心人員,深度參與了谷歌 TPU 2/3/4 的設計與研發,在他看來,TPU 是為 AI 大模型而生的優勢架構。

2023 年,中昊芯英「剎那」芯片正式誕生。「剎那」芯片憑借其獨特的 1024 片芯片高速片間互聯能力,構建了名為「泰則」的大規模智算集群,其系統集群性能遠超傳統 GPU 數十倍,為超千億參數 AIGC 大模型的訓練與推理提供了前所未有的算力保障。這一成就不僅彰顯了中昊芯英在 AI 算力技術領域的深厚積累,更為國產芯片在國際舞臺上贏得了寶貴的一席之地。

然而,在如今人工智能淘金熱,但英偉達 H100 芯片供不應求、價格昂貴的背景下,大大小小的企業都在尋求替代英偉達的 AI 芯片產品,其中包括走傳統 GPU 路線的公司,也包括探尋新型架構的企業。

GPU 面臨的挑戰者,可遠不止 TPU。

在 GPU 路徑研發中,英偉達的勁敵莫過于AMD,今年一月有研究人員在 Frontier 超算集群上,利用其中 8% 左右的 GPU,訓練出一個 GPT 3.5 級別規模的大模型。而 Frontier 超算集群是完全基于 AMD 硬件的,由 37888 個 MI250X GPU 和 9472 個 Epyc 7A53 CPU 組成,這次研究也突破了在 AMD 硬件上突破了先進分布式訓練模型的難點,為 AMD 平臺訓練大模型驗證了可行性。

同時,CUDA 生態也在逐步擊破,今年 7 月英國公司 Spectral Compute 推出了可以為 AMD GPU 原生編譯 CUDA 源代碼的方案,大幅提高了 AMD GPU 對 CUDA 的兼容效率。

英特爾的 Gaudi 3 也在發布時直接對標英偉達 H100。今年 4 月,英特爾就推出用于深度學習和大型生成式 AI 模型的 Gaudi 3,英特爾稱,對比前代,Gaudi 3 可提供四倍的浮點格式 BF16 AI 計算能力,內存帶寬提升 1.5 倍,服務于大規模系統擴展的網絡帶寬提升兩倍。對比英偉達的芯片 H100,如果應用于 7B 和 13B 參數的 Meta Llama2 模型以及 175B 參數的 OpenAI GPT-3 模型中,Gaudi 3 預計可以讓這些模型的訓練時間平均縮短 50%。

此外,應用于 7B 和 70B 參數的 Llama 以及 180B 參數的開源 Falcon 模型時,Gaudi 3 的推理吞吐量預計將比 H100 平均高 50%,推理功效平均高 40%。而且,在較長的輸入和輸出序列上,Gaudi 3 有更大的推理性能優勢。

應用于 7B 和 70B 參數的 Llama 以及 180B 參數的 Falcon 模型時,Gaudi 3 的推理速度相比英偉達 H200 提高 30%。

英特爾稱,Gaudi 3 將在今年第三季度向客戶供應,二季度向包括戴爾、HPE、聯想和 Supermicro 在內的 OEM 廠商提供,但并未公布 Gaudi 3 的售價范圍。

去年 11 月,微軟在 Ignite 技術大會上發布了首款自家研發的 AI 芯片 Azure Maia 100,以及應用于云端軟件服務的芯片 Azure Cobalt。兩款芯片將由臺積電代工,采用 5nm 制程技術。

據悉,英偉達的高端產品一顆有時可賣到 3 萬到 4 萬美元,用于 ChatGPT 的芯片被認為大概就需要有 1 萬顆,這對 AI 公司是個龐大成本。有大量 AI 芯片需求的科技大廠極力尋求可替代的供應來源,微軟選擇自行研發,便是希望增強 ChatGPT 等生成式 AI 產品的性能,同時降低成本。

Cobalt 是基于 Arm 架構的通用型芯片,具有 128 個核心,Maia 100 是一款專為 Azure 云服務和 AI 工作負載設計的 ASIC 芯片,用于云端訓練和推理的,晶體管數量達到 1050 億個。這兩款芯片將導入微軟 Azure 數據中心,支持 OpenAI、Copilot 等服務。

負責 Azure 芯片部門的副總裁 Rani Borkar 表示,微軟已開始用 Bing 和 Office AI 產品測試 Maia 100 芯片,微軟主要 AI 合作伙伴、ChatGPT 開發商 OpenAI,也在進行測試中。有市場評論認為,微軟 AI 芯片立項的時機很巧,正好在微軟、OpenAI 等公司培養的大型語言模型已經開始騰飛之際。

不過,微軟并不認為自己的 AI 芯片可以廣泛替代英偉達的產品。有分析認為,微軟的這一努力如果成功的話,也有可能幫助它在未來與英偉達的談判中更具優勢。

除了芯片巨頭外,也不乏來自初創公司的沖擊。比如 Groq 推出的 LPU、Cerebras 推出的 Wafer Scale Engine 3、Etched 推出的 Sohu 等等。

當下,英偉達大約掌控著 80% 的人工智能數據中心芯片市場,而其余 20% 的大部分則由不同版本的谷歌 TPU 把控。未來,TPU 所占的市場份額會不會持續上揚?會增長幾何?是否會有其他架構的 AI 芯片將現有的市場格局一分為三?這些懸念預計在接下來的數年間將逐步揭曉。

評論