詮釋AI(人工智能)的兩大特征:黑盒子與不確定性

高煥堂? (臺灣VR產業聯盟主席,廈門VR/AR協會榮譽會長兼顧問)

摘? 要:AI擅長尋找大數據中的規律,其亮麗的表現已經令人類嘆為觀止。在學習AI時,如果您能深刻掌握AI的黑盒子(Black box)和不確定性(Uncertainty),將更能發揮AI的專長來幫助人類。

關鍵詞:AI;黑盒子;不確定性

1 AI的長處

當今基于深度學習的AI(人工智能)非常擅長于:從大數據的復雜關系中尋找出人類難以得知的規則(規律性或法則)。人們對周遭大環境的隱藏規律太多未知,AI可以協助人們去探索未知,補足人類的短處。

那么,人們為什么需要AI的助力呢? 因為人們常常只能觀察到小數據,只能歸納出局部性的規律,然后從各個局部性規律中,抽象出原則(Principle),然后掌握原則,并相信它(原則)就代表全體規律,乃是恒久不變之“道”。

如今,AI逐漸打破了這項數千年來的迷思。AI迅速掌握全體大數據,迅速找出全體新規律,顛覆人類所相信的原則。于是,擅于借助于AI者就可得到新規律來引領大潮流。反之,不擅于借助AI者,堅守舊原則,就很可能成為沒落貴族了。

雖然AI擅長從“小范圍大數據”中找規律;但是人類則擅長在“小數據”中找規律,又能舉一反三,應用于“大范圍”上。兩者互補且相輔相成。

例如,在商業競爭環境中,AI可以幫企業取得相關產業的全域最佳解(Global optima),輕易地打敗傳統(無AI)的企業競爭者,因為這些傳統企業只能憑借人的視野和經驗,只能取得局部最佳解(Localoptima)。

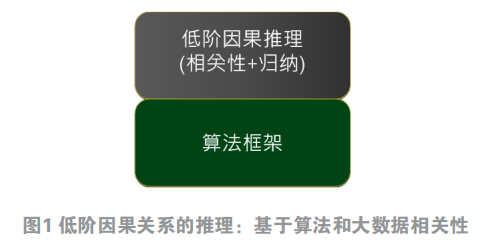

AI有兩項特性:①黑箱式推理;②不確定行為。當 今AI技術是基于算法和大數據相關性(Correlation)而進行歸納推理,屬于低階因果關系的推理(如圖1)。

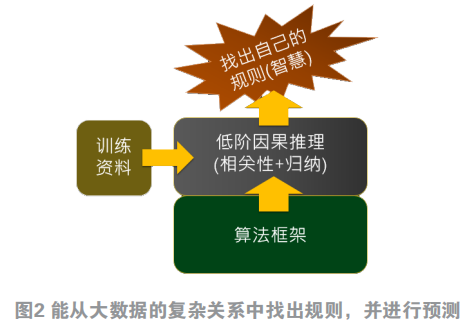

基于底層的算法,搭配歸納推理能力,AI能夠從大數據的復雜關系中找出規則(規律性或法則),并進行預測(如圖2)。

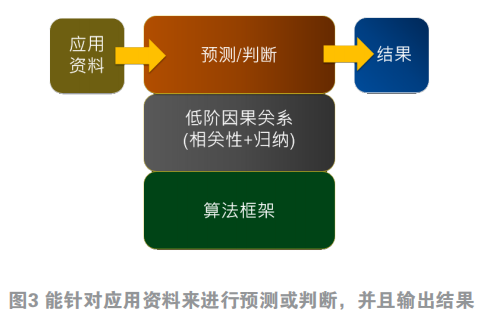

依循AI自己找出的規則,就能針對應用資料來進行預測或判斷,并且輸出結果(如圖3)。

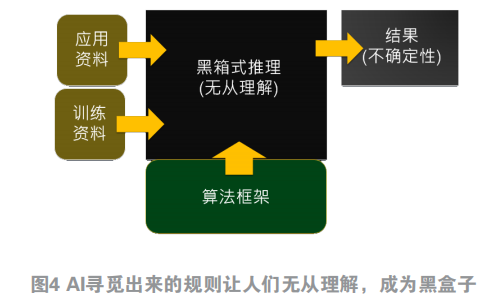

由于AI尋覓出來的規則,只能以成千上億個數字表示,成為無(文)字天書。讓人們對其判斷理由無從理解(Incomprehensibility),且對其推理過程無法解釋(Inexplainability),所以稱之為:黑盒子(如圖4)。

同時,常常因為訓練數據的偏差或算法參數設定等,都會讓AI產生意外的結果,讓人們捉摸不定其行為,通稱為:AI不確定性(Uncertainty of AI)。

3 AI的兩層規則(Rules)

關于AI與規則的關系,首先從AI的算法說起,什么是AI的算法呢?

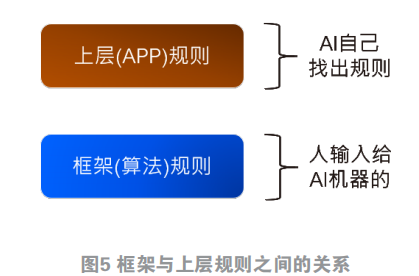

“算法”是人們給予AI機器的規則(Rules)。這種規則是媽媽層級的規則(Meta-rules),成為AI的底層框架,此框架支撐AI的歸納性能力,能夠從大數據中找出規則(規律性或法則),就生出兒女層級的規則(如圖5)。

因為是歸納法,所以媽媽如何生出兒女,其過程是黑盒子。當AI訓練完畢,投入實際應用時,是依循兒女層級的規則而執行。所以,人們常常無法充分掌控AI的行為。

也許您會認為算法能充分掌控AI的行為。其實不然,掌控得了媽媽,并不一定能掌控其兒女,因此人們常常無法充分理解和解釋AI行為的背后理由。

當今的AI神經網絡(NN)受人腦的啟發,一個神經網絡類似于大腦中神經元的連接系統,由成千上萬個微小的神經元連接,經由一系列數學計算,形成數百萬個復雜而微小變化的連結,人類無法精準地確定正在發生的連接結果,只會得到1個輸出的結果。

這種“輸入數據和答案之間的不可觀察的空間”,通稱為黑盒子。在AI領域常拿這個名詞來描述神經網絡的內心深處如何在“暗處”運作的神秘景象。對于人類來說,至今仍然太難理解了。

4 舉例說明:從傳統IT邁向AI

4.1 傳統IT:人們把規則寫入電腦

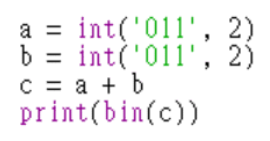

人們最常見的迷思是:延續傳統IT思維,想把自己心中的規則輸入給AI。例如,當您想讓AI來進行二進位的加法運算——如(011)和(011)兩數相加。在傳統IT里,您會利用程序(如Python)的“編程邏輯”來把心中的規則表達于Python程序碼里,經過編譯(Compile)、連結(Link)之后,載入到電腦里。例如,計算二進位的 (011)和(011)相加時,您會運用二進位加法的基本規則是:個位數1和1相加,得到0,且進位 1。下一位則是:1和1和進位1相加,得到1,且進位 1。再下一位則是:0和0和進位1相加,得 到1。于是,得到結果是:二進位的110。然后,寫成Python程序碼來表達之:

此時您需要編程技能和嚴密的程序邏輯。所以,在傳統小數據時代的IT邏輯編程,是讓人類表達其心中的規則,以程序碼敘述出來,植入到電腦中,讓電腦替人類快速執行(規則)。所以,您需要努力學習編程;然而那是傳統IT邏輯思維,不是當今AI的邏輯思維。

4.2 AI:自己找出規則(規律性或法則)

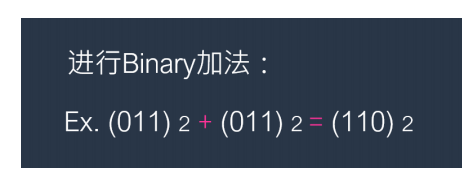

基于大數據的AI邏輯思維是:人類只需要給它(電腦)答案,由它自己歸納出規則。例如二進位加法:

基于大數據的AI邏輯思維是:人類只需要給它(電腦)答案,由它自己歸納出規則。例如二進位加法如圖6。

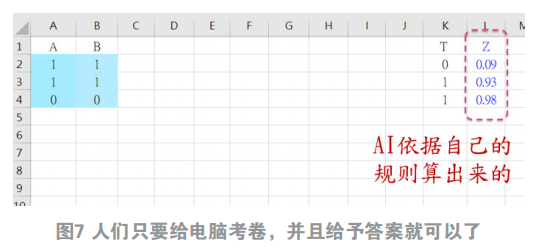

人們只要給電腦考卷(即輸入值011和011),并且給予答案(即輸出值110)就可以了。AI能自己歸納出規則,并計算出非常接近正確的答案(如圖7)。

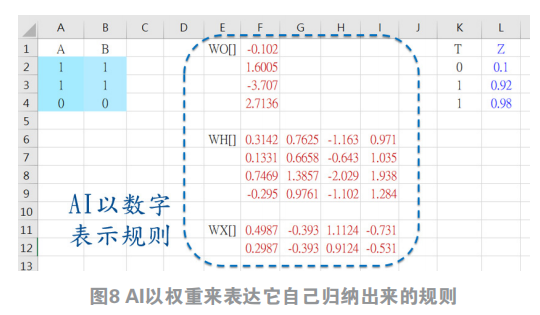

AI計算出來的答案:[0.98, 0.93, 0.09],只是非常接近正確答案:[1,1,0]。AI自己以權重(數字)來表達它自己歸納出來的規則(如圖8)。

在傳統小數據時代的IT邏輯編程,是讓人類表達其心中的規則,以程序碼敘述出來。如今的AI,并不需要人類去表達心中的規則,反而AI基于大數據而能歸納出比人類更優質、可信的規則。

5 細說AI的“不確定性”

5.1 AI的特質:“不確定”行為

如前文所述,AI的特質是非常清晰的:它依賴大數據表層(淺層)的相關性,作為歸納法推理的基礎。而歸納性推理是一種“黑盒子”思維,只有結論而沒有推理過程的。

當AI訓練完畢,投入實際應用時,是依循AI自己歸納出來的規則而執行。所以,人們常常無法充分理解和解釋AI行為的理由。AI自己講不清楚,甚至AI專家也講不清楚。這是人們對于AI行為的不確定感。

于此也推薦您聽聽Janelle Shane于2019年4月在Ted上演講,主題是:AI的危險比你想象的更怪異(The dangerof AI is weirder than you think)[1]。

為了有效提升人們對A I的信賴度(即降低不確定感),許多專家聯合起來籌組了聯盟:A I不確定性聯盟(The Association for Uncertainty in ArtificialIntelligence,簡稱AUAI)[2]。并且定期召開大型會議,研討各種可能的解決途徑。

5.2 AI不擅長“不確定性”的事物

俗語說,優點的另一面往往是缺點。AI擅長于歸納性推理(考古),迅速找出事物幕后蘊藏的規律性。對于沒有經歷過的未知事物通常是無法理解和判斷的。此外,因為AI沒有擬定(對未來的)假設或假說(Hypothesis)的能力,而且它又沒有關于未來可變事物的數據。所以,AI對中長期的未來事物變遷的預測能力卻非常薄弱。這些未知的、未來變遷的不確定的部分,都是AI不擅長的。

在AI時代里,AI負責考古和探索眼前事實;人類觀想未來和擬定假設性方案。AI的能力與人類能力,形成互補,相輔相成,共同邁向人機共舞的社會。

參考文獻

[1] AI報道.從冰激凌實驗看懂AI(2019-12-10)[R/OL].https://baijiahao.baidu.com/s?id=1652513012407958900&wfr=spider&for=pc.

[2] AUAI[R/OL].http://www.auai.org/.

本文來源于科技期刊《電子產品世界》2020年第02期第88頁,歡迎您寫論文時引用,并注明出處。

評論