復雜場景下車輛跟蹤系統研究

基金項目:江蘇省高等學校大學生創新創業訓練計劃項目,項目編號202210900006XJ、202110900004Y;江蘇省高校自然科學研究面上項目,項目編號16KJB510007;教育部產學合作協同育人項目,項目編號201901163002、202002094006

本文引用地址:http://www.j9360.com/article/202307/449136.htm0 引言

隨著社會迅速發展私家車數量不斷增長,頻發交通事故不僅帶來人身傷害和不良影響[1]。因此,智能交通系統研究已得到越來越多的關注[2],主要包括道路管控智能化,交通資源最優化和管理決策科學化,集成信息技術和圖像處理技術等技術[3-4],重要前提基礎就是實現車輛跟蹤監測[5],通過攝像頭采用圖像處理技術[6],獲得道路車輛行動軌跡[7]。

19 世紀中期瓦克斯首先提出運動目標跟蹤,19 世紀60 年代Sittler 提出了目標軌跡概念并對瓦克斯提出的基礎理論進行改進和補充。10 年后,卡爾曼濾波在目標跟蹤領域取得突破后,該技術才真正走進大眾視野并獲得研究人員的普遍關注[8],粒子波跟蹤算法[9]、Kalman 濾波,Meanshift 算法等經典傳統算法[10] 被相應提出。

近年來,隨著機器學習不斷深入[11-12],TLD 算法因其可進行長時間的目標跟蹤而得到廣泛應用[13-14]。2012 年的CSK 算法,改進了訓練樣本集,一定程度上降低了算法運行所需的時間和資源,也提高了目標跟蹤的精準程度;2015 年利用方向梯度直方圖來代替單通道的灰度特征,進一步提升運行效率和性能[15]。此外,國內重點大學和重點研究室如中科院、清華大學、浙江大學等紛紛在手勢識別、人臉識別或姿態識別等領域取得了重大突破[16-17]。針對不同的車輛具有不同的車輛特征,較為常見的車輛跟蹤算法[18-20]有區域匹配跟蹤算法、特征匹配算法、輪廓匹配跟蹤算法和3D 跟蹤算法。

然而目前采用的車輛跟蹤技術大多只適用于特定環境或場合,實際道路交通中非常復雜有很多影響因素,車輛跟蹤要適應場景的變化,如光照條件變化;其他物體的干擾如陰影、來往人群、車輛在場景中的鏡面反射等;監控場景中的龐大的車輛數量、車輛進出場景、尺度變化、視角變化及物體遮擋等[21-22]。若在車輛突然拐彎,車身被行人或路邊標志牌遮擋,太陽光線在多云季節因為云層移動而導致光照強度發生變動等復雜場景下,則無法做到精確跟蹤車輛軌跡。為方便追蹤車輛行動軌跡和車輛具體狀況,復雜場景下的車輛跟蹤系統一直是研究熱點和話題,本文針對復雜場景下車輛運動展開研究,針對目標車輛的跟蹤構造相應框架和模塊并設計算法流程。

1 復雜場景下的車輛跟蹤系統

1.1 系統整體框架

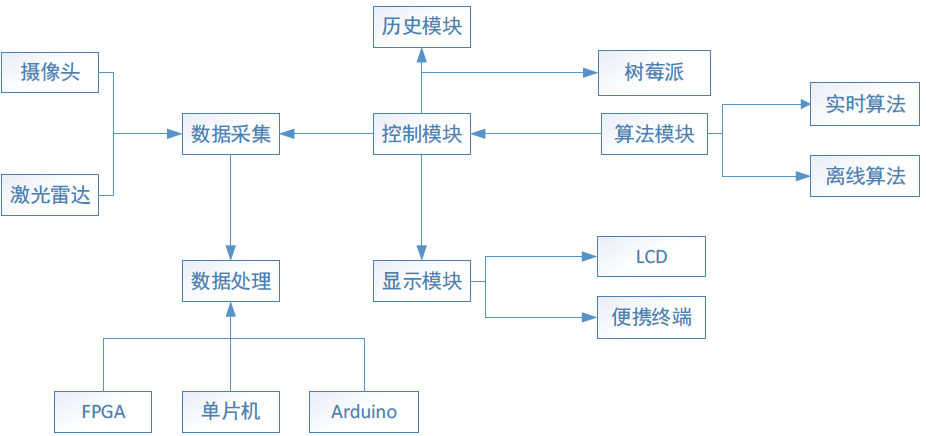

本系統整體框架如圖1所示,控制模塊是整個系統的核心部件,既包含相應的硬件設施也包含了實時算法和離線算法,實時算法通過圖像處理進行,而離線算法通常使用數模轉換算法;具備數據采集、數據顯示、存儲歷史信息等功能。控制模塊還可以通過手機、液晶顯示屏或LCD 等便攜終端實現信息的實時顯示,而歷史模塊則是通過專門的歷史記錄模塊進行存儲。

圖1 系統整體框架圖

數據采集功能主要通過攝像頭和激光雷達捕捉目標車輛的行駛軌跡和實時位置來完成,之后再將數據傳遞給FPGA、單片機或Arduino平臺,利用可編程電子平臺對采集到的數據進行處理。主要是車輛在行駛過程中的軌跡、速度、位置等信息,目前常用器件為攝像頭或激光雷達。激光雷達探測范圍廣,精度高,魯棒性好,利用高精地圖可實現自動定位和目標跟蹤。

系統利用FPGA、單片機和Arduino進行數據處理,并利用歷史模塊存儲數據信息。目標車輛的歷史信息包括運動軌跡、車輛狀態、速度等均保存在歷史模塊中,該模塊可保持數據歷史信息的嚴密性、準確性和完整性。

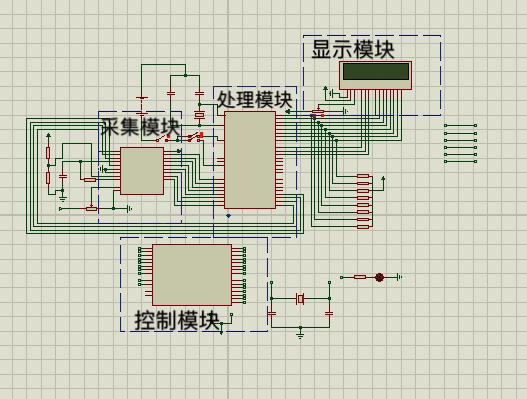

顯示模塊是在數據采集處理后再進行的,通常顯示平臺為LCD 顯示屏。該系統通過顯示模塊可顯示目標車輛具體信息,可顯示由數據采集模塊被車輛遮擋的盲區圖像和目標車輛的行駛參數。對系統模塊的部分功能利用Proteus 進行電路設計如圖2 所示。

圖2 電路設計圖

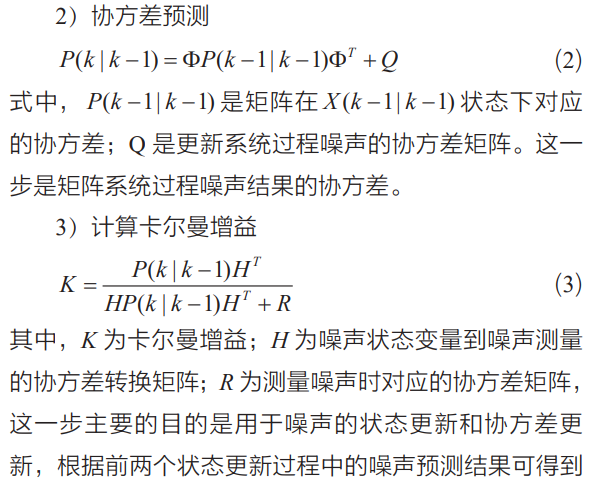

整個過程主要包括五個方面的計算:

1)狀態預測

![]() (1)

(1)

其中,X (k ?1| k ?1)是利用上一時刻所在狀態預測得到的最優化結果,這一步實際是更新系統結構。

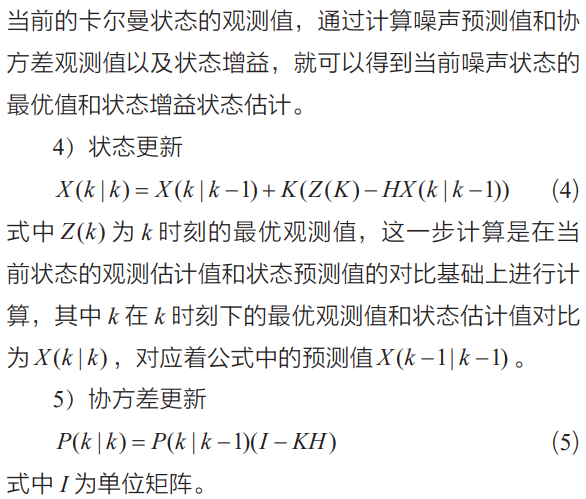

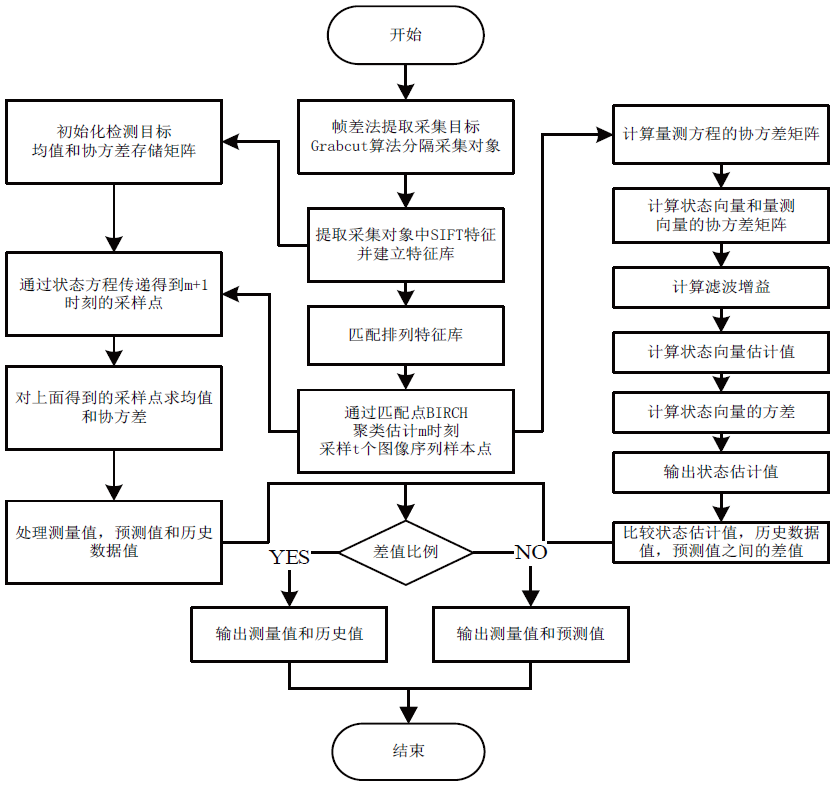

本系統算法流程如圖3 所示,通過算法估計進一步預測目標車輛位置進行跟蹤,可在測量方差已知的情況下去估計運動目標的狀態。首先利用幀差法提取采集目標即目標車輛并利用Grabcut算法進行圖像分割,然后提取采集車輛中的SIFT 特征并建立特征庫,初始化檢測車輛的均值和協方差存儲矩陣。建立特征庫后進行匹配排列再通過聚類估計某時刻的序列樣本點,一方面通過狀態方程得到下一時刻的樣本點并依次計算出均值和協方差,另一方面計算量測方程的協方差矩陣并依次計算濾波增益、狀態向量估計值、狀態向量的方差,然后輸出狀態估計值。對兩個方向的測量值、預測值、歷史數據值進行處理,最后通過比較差值比例選擇合適的輸出值。

圖3 系統算法流程圖

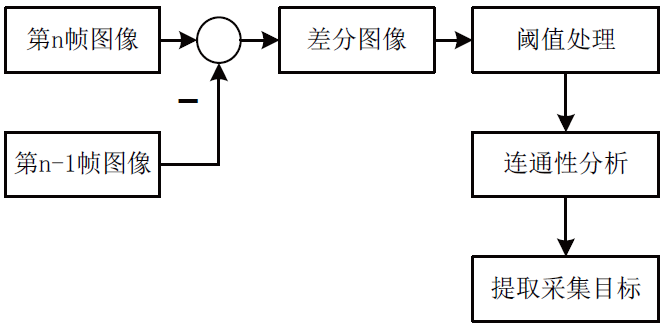

目標車輛在行駛過程中,攝像頭角度位置不會發生變化,則每一幀圖片中的位置都不相同,則對當前所在幀和下一幀的圖像進行差分運算,提取目標車輛所有數據信息,其流程如圖 4 所示。算法按過程分為圖像初始化的過程和迭代的過程。此算法在系統中利用Grabcut切割算法對采集對象的像素點即目標車輛進行圖像分割。系統初始化圖像分割完成后,進入迭代分割區,系統對迭代區域中未知分割像素點的能量值進行重新分配。

圖4 幀差法提取采集對象

首先對目標車輛的SIFT特征進行提取并建立特征庫,然后匹配排列特征庫,再進行聚類估計序列樣本點。針對兩個時刻對目標車輛跟蹤進行比較選擇。首先,計算m時刻樣本點的量測方程的協方差矩陣、狀態向量和量測向量的協方差矩陣、濾波增益、狀態向量估計值和狀態向量的方差。再者通過初始化目標車輛存儲歷史數據和協方差矩陣,得到并計算m+1時刻樣本點的均值和協方差。最后處理兩個時刻得到的測量值、預測值和歷史數據值,對預測值、歷史數據值、測量值三者之間的差值進行比例分析。若差值比例高,輸出測量值和歷史值;若差值比例不高,則輸出測量值和預測值。

2 結束語

本文主要研究了復雜環境下如何對車輛進行跟蹤和檢測,本文首先對國內外研究現狀做出了大量研究,分析了實現車輛跟蹤檢測的研究意義,然后介紹了車輛跟蹤中常用的一些算法,并在此基礎上針對車輛跟蹤中的難點進行相應的算法改進。針對車輛在跟蹤過程中容易發生“姿態變化”導致跟蹤難以實現,本文引入SIFT算法提取目標特征點,為保證SIFT 所提取的興趣點位于圖片前景,利用Grabcut 算法對圖片進行背景分離處理,此外加入BIRCH 算法實現目標車輛的聚類估計。本課題后續研究的內容將準備在如下方面繼續深入研究,一是在使用SIFT 算法提取目標特征點的基礎上,進一步引入車輛自身特征進行深層次分析。二是在日常生活中,攝像頭多是可以變換拍攝角度的,利用這類攝像頭實現車輛動態跟蹤更為困難,這也是本課題后期將拓展研究的地方。

參考文獻:

[1] 程騰, 等. 一種基于數字圖像相關的高精度車輛跟蹤算法[J]. 汽車工程, 2018, 40(8): 942-946,980.

[2] 侯瀟瀟. UKF和小波變換結合的車輛跟蹤算法的研究[D]. 淮南:安徽理工大學, 2017.

[3] 吳寧強, 等. 重載AGV車輛跟蹤算法和運動特性研究[J]. 重慶理工大學學報(自然科學版), 2018, 32(10): 53-57.

[4] 宋國浩. 基于機器視覺的智能車輛跟蹤方法研究與應用[D]. 太原:中北大學, 2017.

[5] 施毅等. 基于時空馬爾可夫隨機場模型的車輛跟蹤算法研究[J].土木工程學報, 2007, 40(1): 74-78.

[6] 林明秀, 劉偉佳, 徐心和. 基于模板匹配的多模式車輛跟蹤算法[J]. 系統仿真學報, 2007, 19(7): 1519-1522.

[7] 周俊靜, 段建民, 楊光祖. 基于改進的確定性目標關聯的車輛跟蹤方法[J]. 模式識別與人工智能, 2014(1): 89-95.

[8] 袁基煒, 史忠科. 一種基于灰色預測模型GM(1,1)的運動車輛跟蹤方法[J]. 控制與決策, 2006(3): 300-304.

[9] 郭新新. 基于粒子濾波的車輛跟蹤算法研究[D].濟南:山東師范大學, 2018.

[10] 顧鵬笠. 基于機器學習的車輛跟蹤與道路場景理解研究[D]. 杭州:浙江科技學院, 2019.

[11] 陳夢. 基于深度學習的車輛跟蹤的研究[D]. 南京:南京郵電大學, 2018.

[12] 卜旭輝,等. 基于迭代學習的農業車輛路徑跟蹤控制[J]. 自動化學報, 2014, 40(02): 368-372.

[13] 張帥領. 基于TLD的視頻目標跟蹤算法的研究[D]. 西安:西安電子科技大學, 2014.

[14] 李敏敏. 基于TLD模型的目標跟蹤方法[D]. 西安:西安電子科技大學, 2013.

[15] 權義萍,等. 基于Mean-Shift的卡爾曼粒子濾波車輛跟蹤算法研究[J]. 計算機應用與軟件, 2014(9): 236-239,252.

[16] 李文輝, 陳昱昊, 王瑩. 自適應的免疫粒子濾波車輛跟蹤算法[J]. 吉林大學學報(理學版), 2016, 54(5): 1055-1063.

[17] 范玉貞, 李海軍. 基于改進分水嶺算法的多目標車輛的跟蹤研究[J]. 電子世界, 2013(3): 1-2.

[18] 李娟. 基于數據融合的危險駕駛行為識別與車輛跟蹤算法研究[D]. 武漢:武漢工程大學, 2017.

[19] 紀筱鵬, 魏志強. 基于輪廓特征及擴展Kalman濾波的車輛跟蹤方法研究[J]. 中國圖象圖形學報A, 2011, 16(2): 267-272.

[20] 童寶鋒. 基于視覺傳感器的前方車輛跟蹤定位方法研究[D]. 長春:吉林大學, 2014.

[21] 楊敏,等. 一種基于運動目標檢測的視覺車輛跟蹤方法[J]. 北京理工大學學報, 2014, 34(4): 370-375.

[22] KOLLNIG H, H H NAGEL, M OTTE. Association of motion verbs with vehicle movements extracted from dense optical flow fields[A]. Computer Vision - ECCV’94, Third European Conference on Computer Vision, Stockholm, Sweden, May 2-6, 1994, Proceedings, Volume II[C]. 1994.

(本文來源于《電子產品世界》雜志2023年7月期)

評論