立體攝像深度感知的FPGA實現(xiàn)

針對立體攝像的深度感知,FPGA解決方案能使處理器的時間得到緩解,減少或除去器件的成本,例如MPU、DSP、激光器和昂貴的鏡頭。通過提供給機器人其環(huán)境中的差異測繪,FPGA使機器人中的CPU專注于重要的高層任務,例如建圖和定位。

本文引用地址:http://www.j9360.com/article/150905.htm差異測繪

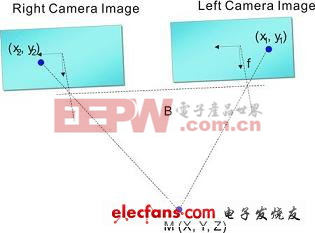

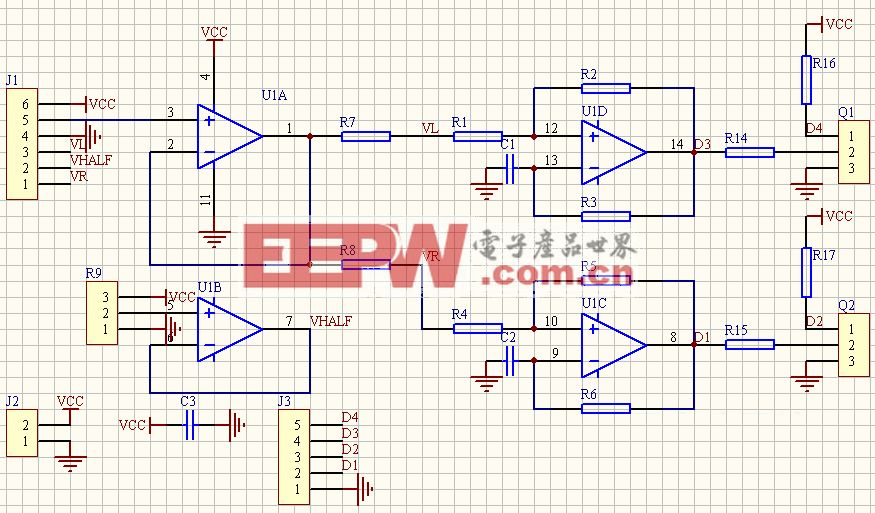

加深度感知到機器人的常用技術是用兩個水平放置的獨立攝像機,互相之間平行分開放置。用差異測繪算法對兩個攝像機進行比較,見圖1。

圖1 差異測繪計算

簡單來說,差異是指右面和左面圖像之間的差別。物體越接近攝像機,兩個圖像之間的差異越大。

你可以自己來做一個實驗,對著你的臉水平地向上握住一支筆,不停地眨你的左眼和右眼。移動的筆越接近你的臉,你眨眼時覺得移動越多。做更多的移動時,物體越接近你的眼睛,圖像中的差異越大。

如圖1所示,從兩個圖像之間物體的位置算出差異:d=x1-x2。為了計算點M的實際坐標,可通過左面和右面的攝像機來進行計算:

X=Bx1/d

Y=By1/d

Z=fB/d

相關的問題

計算差異測繪依賴于相關的圖像,以及左面圖像和右面圖像的匹配性質(zhì)。逐點計算相關的像素的計算量是很大的,因此用其它算法來簡化這個問題。有一種方法稱為圖像點相關,仔細檢查左面圖像的像素塊,稱為點,然后在右面圖像中尋找相同的點。其它的方法包括邊沿檢測和匹配。一旦定位了相應的圖像,就可進行差異計算。

失真與曝光問題

如果使用高質(zhì)量的攝像機,可以忽略鏡頭失真。為了省錢,使用便宜的CMOS 或者CCD攝像機,或者低成本廣角鏡頭。這些較低質(zhì)量的產(chǎn)品會引入失真或曝光問題。

鏡頭會引起比例和定位失真,例如白點效應,靠近圖像外面的物體出現(xiàn)彎曲狀,使用眾所周知的圖像處理算法可以進行補償。針對移動或者其它幾何算法,糾正白點的一種方法是使用坐標的查找表重測圖像中的像素。

在非常明亮和非常暗的環(huán)境中,其它的算法需要可靠地捕獲圖像中的詳細特征。例如,針對不同的區(qū)域確定最佳的曝光設置,使用區(qū)域的合成圖像可以補償缺少背景亮度。

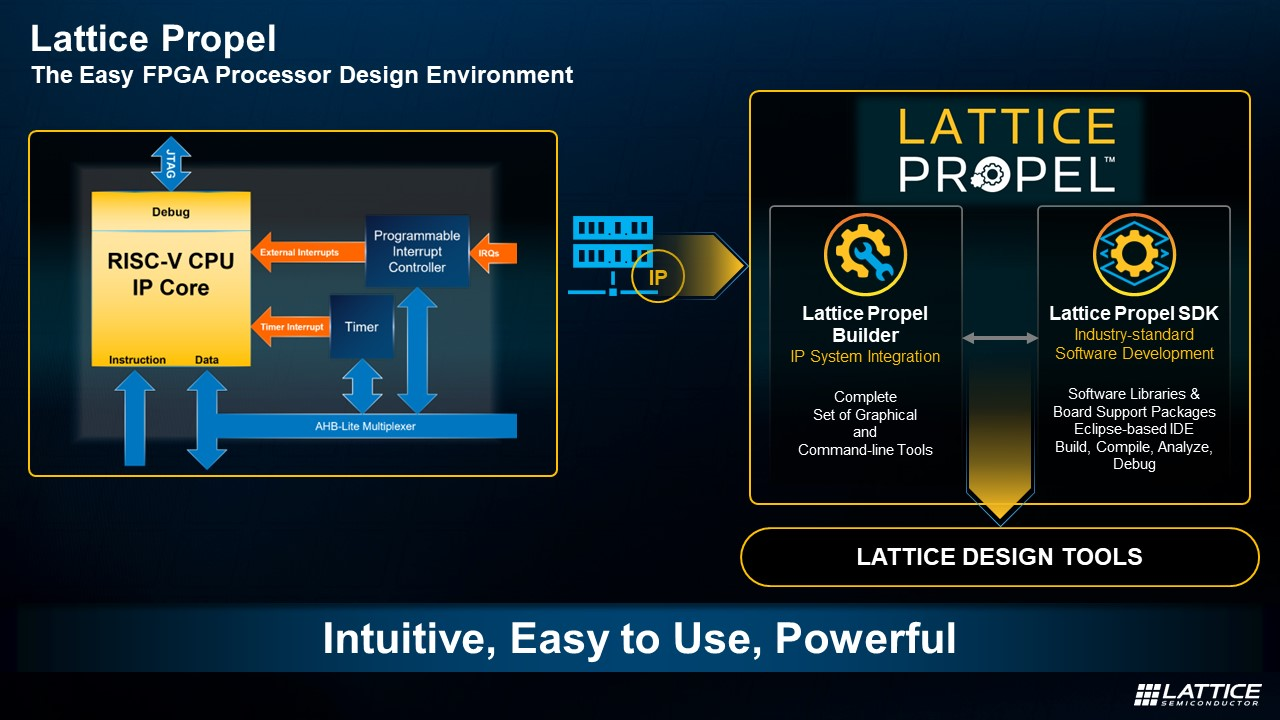

用含有嵌入式DSP的FPGA的解決方案

本文中闡述的深度感知算法計算復雜,以實時的視頻速率來實現(xiàn)。系統(tǒng)設計者必須評估CPU/軟件、ASIC, ASSP(例如DSP處理器)和FPGA解決方案,確定哪個是最佳的,以及FPGA價格。

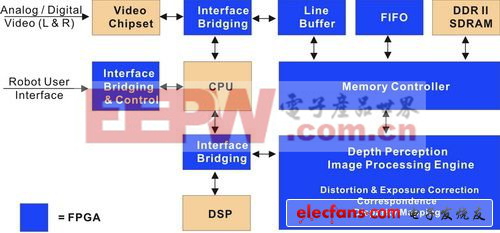

圖2展示了提出的FPGA協(xié)處理器解決方案,解決失真、曝光、通信和針對深度感知差異測繪算法。這個方法使CPU騰出時間,允許DSP處理器處理更多的串行任務。

圖2 FPGA支持計算量大的差異測繪算法

評論